机器学习

梯度提升树模型

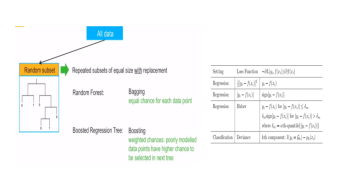

增强回归树模型。如名所示,这类模型是两种技术的结合:决策树模型和增强方法。像随机森林模型一样,增强回归树模型通过不断拟合多个决策树来提高模型的准确性。这两种方法的区别之一是选择构建树的数据的方法。这两种技术都是从全部数据中随机选择构建每个新树的数据。所有随机子集具有相同的数据量,都是从完整的数据集中选择。用过的数据会放回到完整数据集中,以便在随后的树中再次选择。如上所述,随机森林模型使用装袋的方法选择数据。使用这种方法,每个数据点被每个新的随机子集选中的概率相同。增强回归树使用增强方法,在后续建立的树中对输入数据进行加权。加权方法是,在之前的树中建模较差的数据有较高的概率被新树选中。所以,在这个过程中,拟合完第一棵树之后,模型在拟合下一棵树的时候就会考虑该树的预测残差等。通过考虑以前构建树的拟合结果,模型不断改进以增加准确性。这种顺序方法的增强具有唯一性。